対話型AIで探る医学情報 ②Perplexity AI編

~水腎症の原因/尿路結石症の記事との比較~

<目次>

以前、日本語が使えるChatGPT(GPT-3.5, 拡張機能なし)を用いて、医学情報収集で使えそうなことをチェックしてきました。その後、少し横道に逸れてしまい申し訳ございませんでした。今回はその続編としてのPerplexity AI版となります。

今回も、水腎症の原因と尿路結石症に対する超音波検査の感度・特異度の記事との比較を前提にしながら、チェックしていきたいと思います。4月下旬時点でのスクショによる記録が古くなったと感じたため、5月下旬の結果をもとにチェックしていきたいと思います。

【導入】Perplexity AI(英語)

やはり、ChatGPTとの大きな違いは、日本語がデフォルトでは使えないことがあることでしょうか。しかし、英語を使うことで選択肢が広がったり、引用元(参考文献)が分かるというような大きなメリットも教授することができます。

(注)日本語での利用を諦めるきっかけとなった一例も番外編で後ほど共有致します。

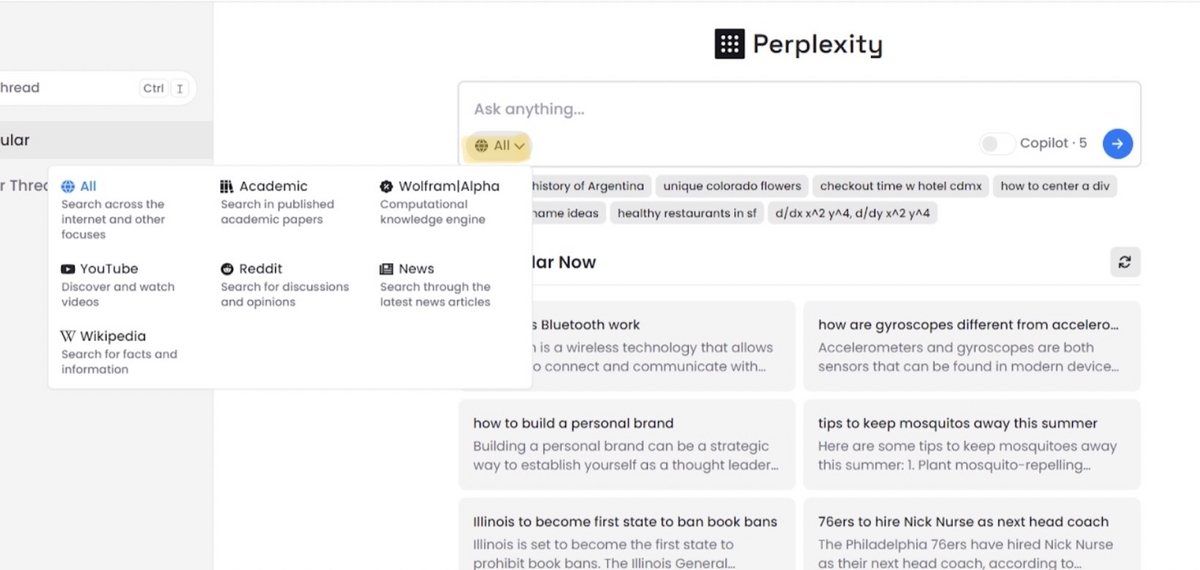

Perplexity AIでは質問をする際に、「All」、「Academic」、「Wolfram | Alpha」「YouTube」、「Reddit」、「New」、「Wikipedia」と項目が選べます(2023年5月下旬時点)。それでは、今回の医学情報収集という主旨で使いそうな「All」と「Academic」を具体的にチェックしていきたいと思います。

(注)「All」は2023年4月には「Internet」と表記されていたり、「WolformlAlpha」や「News」が追加となっています。

1. 水腎症の原因(成人)

今回は、参考文献も明示してくれる対話型AIであるPerplexity AIを使ってみたいと思います。それでは、成人における水腎症の原因から調べてみます。

1-1. 「All」×水腎症の原因(成人)

それでは、成人における水腎症の原因をPerplexity AIに尋ねてみます。まずは「All」で検索してみます。

いかがでしょうか。ChatGPTとも回答の仕方は似ていますね。上手に箇条書きを交えて回答しています。しかも、回答内容としてもChatGPTのときのような、あきらかな幻覚(hallcination)を疑う記述はありません。

水腎症の病態も記述されたのちに、箇条書きで主な原因を挙げています。箇条書きで、腎結石、先天性の原因、血塊、術後・外傷などの組織の損傷、腫瘍、前立腺肥大、妊娠といった状態が挙げられています。それ以外の多くはない原因にも触れられています。

そして、本当か気になれば出典をみることができます。やはり、ここでのPerplexity AIのメリットは出典があることでしょう。そして、出典を見に行くと分かるのですが、英国のNHS、Mayo ClinicやCleveland Clinicのような信憑性もそれなりにありそうなホームページから引用されています。出典もキレイにまとめられたページなので、出典を見に行くために使ってもよいかもしれません。

<出典一覧>

-

https://my.clevelandclinic.org/health/diseases/15417-hydronephrosis

-

https://www.mayoclinic.org/diseases-conditions/hydronephrosis/cdc-20397563

-

https://www.webmd.com/a-to-z-guides/what-to-know-hydronephrosis

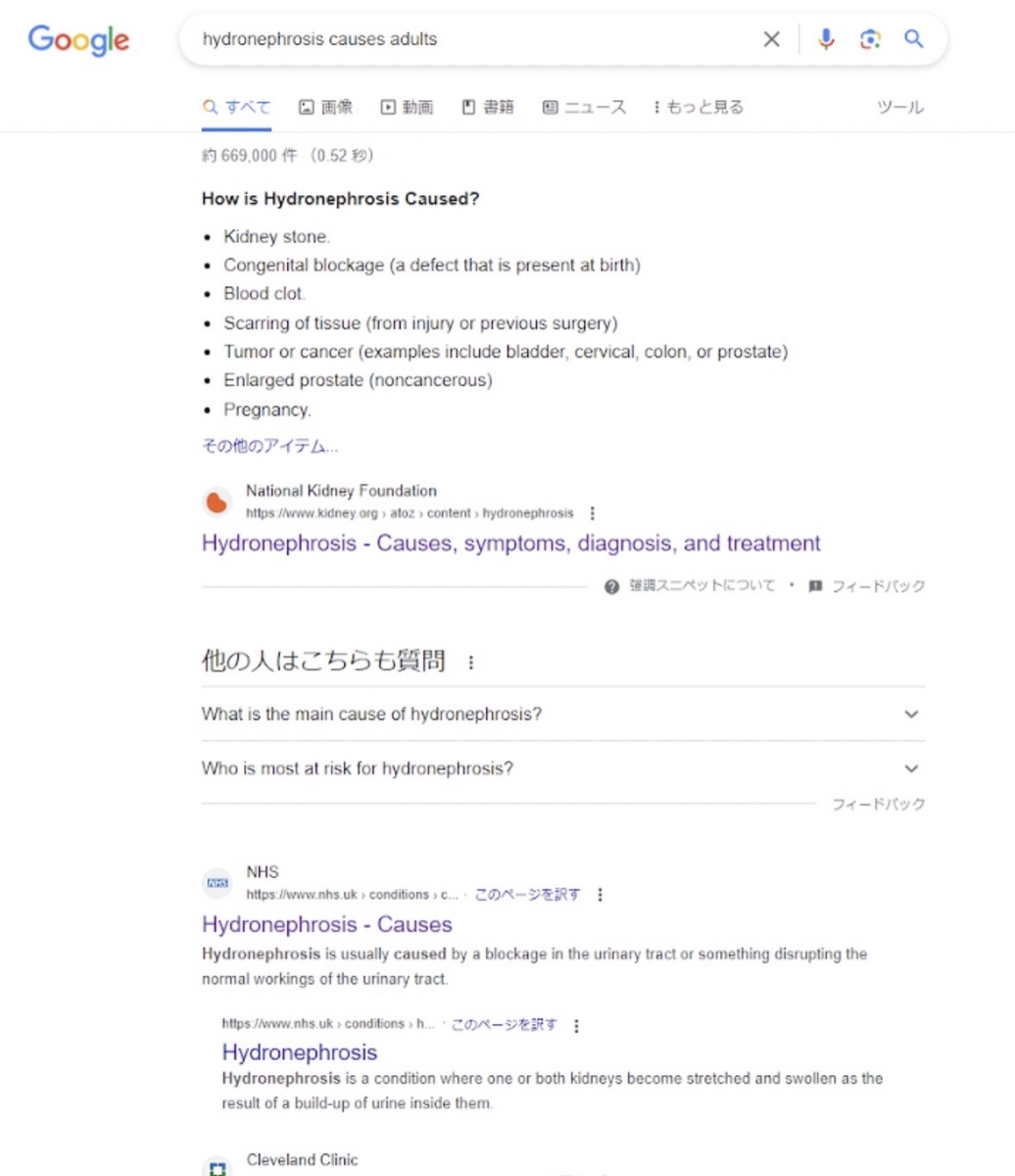

【補足】Google検索でも大丈夫!?

Perplexity AIからの回答を見ていて、どうせ出典を見に行くだけなら、Google検索でも大丈夫なんじゃないかと思ったので、検索してみました。

先ほどのPerplexity AIが出典にしていた5つのサイトすべてが、Google検索の検索のトップの方に表示されていました。

広告ビジネス、検索村八分のような状況も考えれば、補完になると思います。しかし、おこまでPerplexity AIに質問しなくても、これらのサイトをチェックするのも一貫性のある書かれ方をしているので良いと思います。

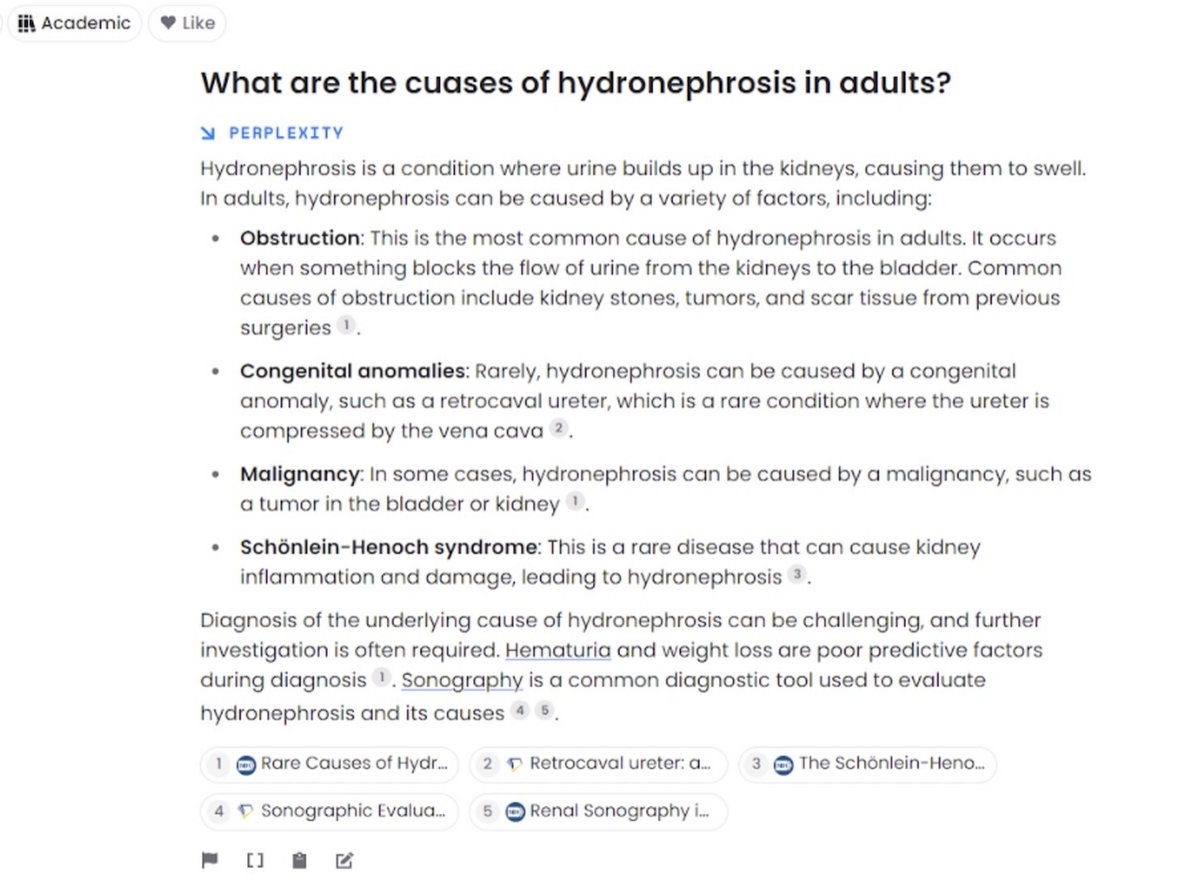

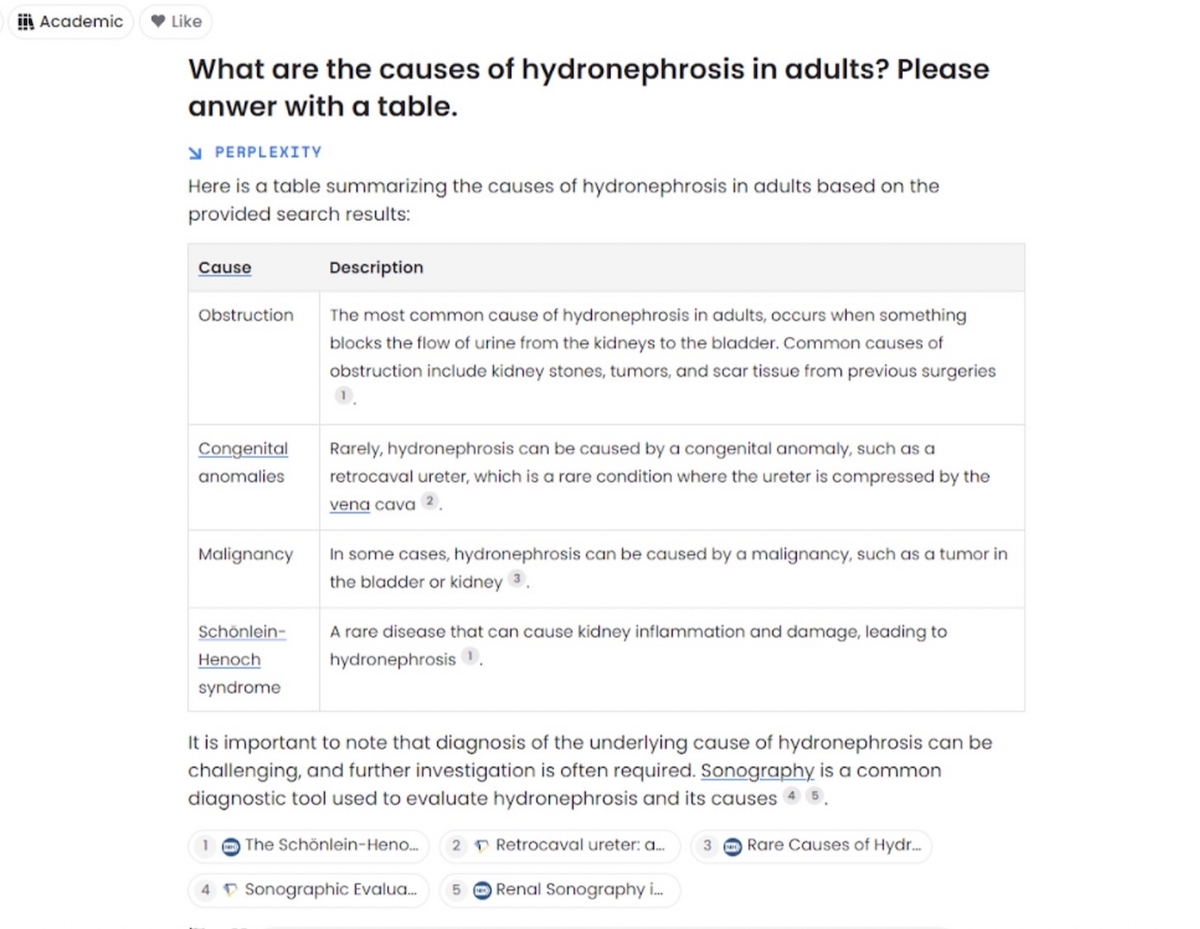

1-2A. 「Academic」×水腎症の原因(成人)

続いて、Perplexityの目玉でもある「Academic」設定で質問してみたいと思います。これこそがChatGPTでは中々扱いにくかったプロンプト設定のような部分になります。

記述の仕方は先ほどの「All」の設定の時と似ています。出典が学術的なものになった点が大きな変更点です。

内容についてチェックしていくと、閉塞(obstruction)、先天的な原因(congenital anomalies)、悪性腫瘍(malignancy)と特に違和感はありません。しかし、ここで急に箇条書きの項目として、Schönlein-Henoch syndromeが登場します。ここで出典の記載があることが威力を発揮します。

出典をチェックしました。その文献のPDF内でhydronephrosisと検索をかけると1箇所のみ検索に引っ掛かります。その部分を読んでみると、症例報告のような形で1症例で水腎症が見られたという程度の記述になります。果たして、どこまで一般化できるのかは疑問です。しかも、1956年というのは驚きです。

箇条書きの下の部分の記述として、血尿や体重減少は予後不良因子というような興味深いことまで書いてあります。

この研究をチェックしてみると、2001年から2015年の間に珍しい原因によって水腎症になった100症例から予後不良因子を探すという研究です。以前、Google ScholarやPubMedでベストマッチで検索したときには上位で見かけた記憶はありません。妙にオープンアクセスの論文が多く、名も知らない・見た目から大丈夫かと不安になるジャーナル、古い論文が紛れ込む印象です

そして、超音波検査(sonography)についても言及されています。後ほど、尿路結石症の診断特性のところで超音波検査についても調べてみたいと思います。

今回の出典は下記の通りです。こんな論文もあったのかという視点で楽しむこともできます。

<出典一覧>

- https://www.ncbi.nlm.nih.gov/pmc/articles/PMC7306661/

- https://www.semanticscholar.org/paper/Retrocaval-ureter%3A-an-unsual-cause-of-in-an-adult-Hassan-Mohamed/246519f0b1f06e6b2a6509e4b3aaea0ce3541f4a

- https://pubmed.ncbi.nlm.nih.gov/13363484/

- https://www.semanticscholar.org/paper/Sonographic-Evaluation-of-Hydronephrosis-and-the-of-Kaleem-John/9a76ab1d7798e587f1011df7ba079e775f70b06b

- https://pubmed.ncbi.nlm.nih.gov/12008810/

論文のタイトルがこのようなものからなのか、オープンアクセス可能なものが多いなのか、なぜここから引用してきたのか、もっと良いものはなかったのかというような疑問もありますが、面白い文献を見つけるきっかけ、自分なりの仮説をサポートしてくれる文献を見つけるというような使い方、論文のタイトルではなかなかチェックしてみようとは思えないものを克服するような使い方が効果的かもしれません。

初学者や全体像の把握という視点では、Perplexity AIに限定すれば、まずは「Academic」よりも「All」の方が良いかもしれません。もちろん、2次文献や教科書等も忘れてはならないと思います。

1-2B.「Academic」×表作成

せっかく、対話型AI(チャットAI)に質問しているので、ChatGPTで良かったと感じた表の作成をお願いしてみることにしました。

基本的な回答は先ほど(1-2A)と同じです。出典も順番こそ異なりますが、同じになります。個人的には、表になることで少し見やすくなったと感じます。Schönlein-Henoch syndromeが表で1行使用しているのは、違和感で「その他」のひとつにでもすれば良かったのではないかとさえ感じます。

使用に際して、1カ月前とはまた異なる回答をしていることからも、フィードバックをはじめ、人によっても、日時によっても、変化していくことも考えられます。

【補足】Reviewとの比較(スライド)

以前の記事で作成したスライドです。Review articleをもとに作成したスライドとPerplexity AIの回答の比較です。

普段、1回ぽっきりのような使い方であれば、対話型AIによる回答にちょっと手直しするぐらいの使い方が、事務作業も省けて良いと感じています。

ゼロベースで人が作るのは非効率かもしれません。もしくは、よほど1対多数で使うようなもの等に限定して、人がゼロベースで作るものを使わないと、時間等が有限の場面では勿体ないとも感じます。もちろん、新たなデータ作成・発見のようなものはまだ人が必要だとは思います。

画像生成AIまで駆使して、その画像のスライドに貼り付ければ、デザインとしては綺麗になるかもしれません。istockのようなスライドの素材以上にお金もかからずに使いやすいと考えています。

2. 尿路結石症に対する超音波検査の診断特性

尿路結石症の診断に超音波検査がどの程度有用かということを以前の記事で調べていました。それになぞって調べてみたいと思います。

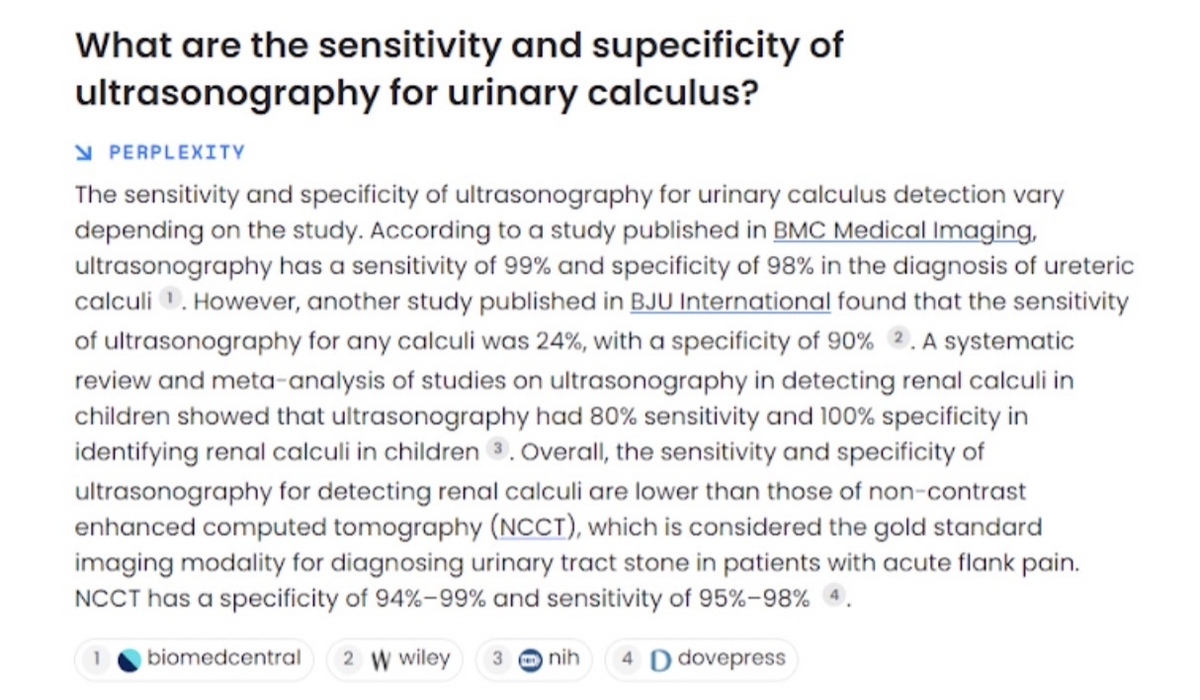

2-1.「All」×Perplexity AI

まずは、「All」設定設定で調べてみます。

ChatGPTよりも出典もあるので、安心して読むことができます。「All」なのですが、論文から引用されています。

出典一覧

- https://bmcmedimaging.biomedcentral.com/articles/10.1186/1471-2342-4-2

- https://bjui-journals.onlinelibrary.wiley.com/doi/full/10.1111/bju.13605

- https://www.ncbi.nlm.nih.gov/pmc/articles/PMC6942918/

- https://www.dovepress.com/the-role-of-ultrasonography-in-detecting-urinary-tract-calculi-compare-peer-reviewed-fulltext-article-RRU

PubMedやGoogle Scholar等で調べた時の検索結果の表示のされ方とは異なる論文のラインナップです。最初の一文目の「尿路結石症に対する超音波検査の感度、特異度は研究によって様々である」という言葉に集約されていますが、参考になる研究をチェックすることができます。3つ目の論文のようにSystematic Reviewとメタ解析のものもあります。

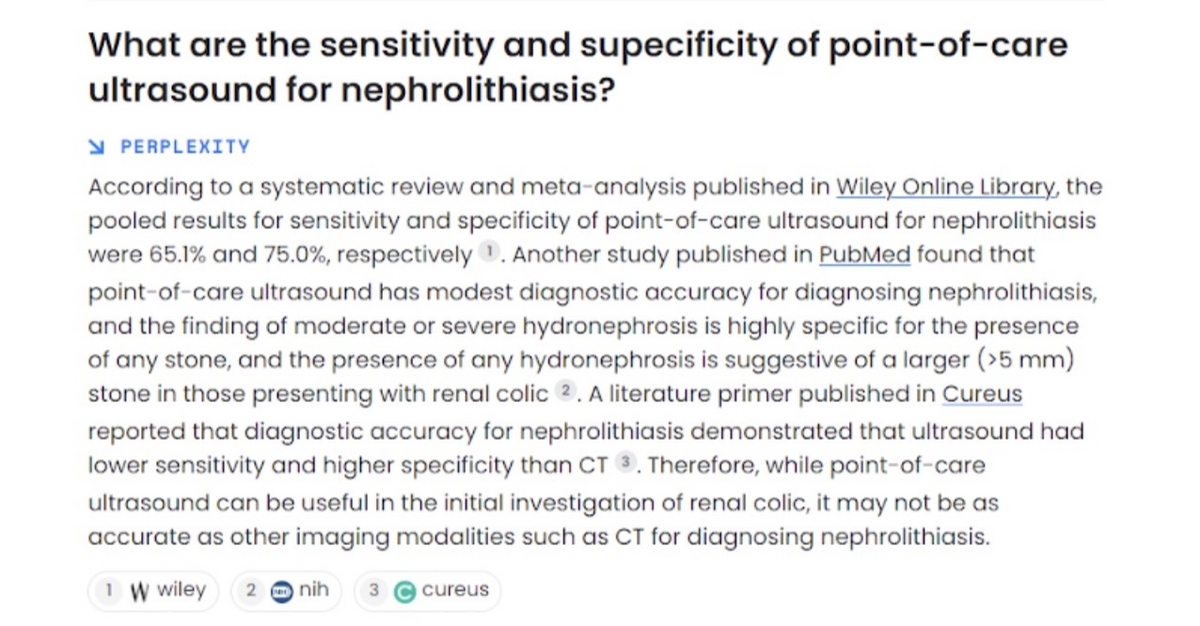

もう少し、条件を厳しくして質問してみます。以前のブログ記事のSystematic Reviewならびにメタ解析の論文の条件に近づけてみます。超音波検査をPOCUS(point-of-care ultrasound)に、尿路結石を腎結石に絞ってみました。

なかなか健闘しているように見えます。先ほど、もしくはこれぐらいの内容になると、チェックしたいと思う研究が出てくるのではないでしょうか。

<出典一覧>

- https://onlinelibrary.wiley.com/doi/full/10.1111/acem.13388

- https://pubmed.ncbi.nlm.nih.gov/29427476/

- https://www.cureus.com/articles/145495-point-of-care-ultrasound-pocus-literature-primer-key-papers-on-renal-and-biliary-pocus?authors-tab=true#!/

まず、突っ込みどころとしては出典1と出典2は同じ論文(DOI: 10.1111/acem.13388)でした(笑)。まあ、ネット上のページとして異なるので、別にカウントしたという事なんですかね…。

しかも、出典1(出典2)は、以前ブログでも紹介したSystematic Reviewとメタ解析の研究です。論文内容をそれなりに覚えていたので、次の文章の部分にすぐに違和感を感じました。数字が違うと感じたわけです。Perplexity AIでは、“the pooled results for sensitivity and specificity of point-of-care ultrasound for nephrolithiasis were 65.1% and 75.0%, respectively”と誤って表現されています。しかし、論文中で正しくは、“The pooled results for sensitivity and specificity were 70.2% (95% confidence interval [CI] = 67.1%-73.2%) and 75.4% (95% CI = 72.5%-78.2%), respectively”です。これも、意味というより文字列として処理した結果の幻覚(hallcination)のひとつでしょうか。

チェックしていくと、このように誤った部分も次々と見つかってくるでしょう。そういう視点では、Google検索、PubMed検索等と同じく、文献探しに使うといったところでしょうか。そして、まずはアブストラクトを自分自身で読んだり、その論文内で今回で言うとsensitivityをはじめとするキーワード検索でチェックすることも必要だと思います。

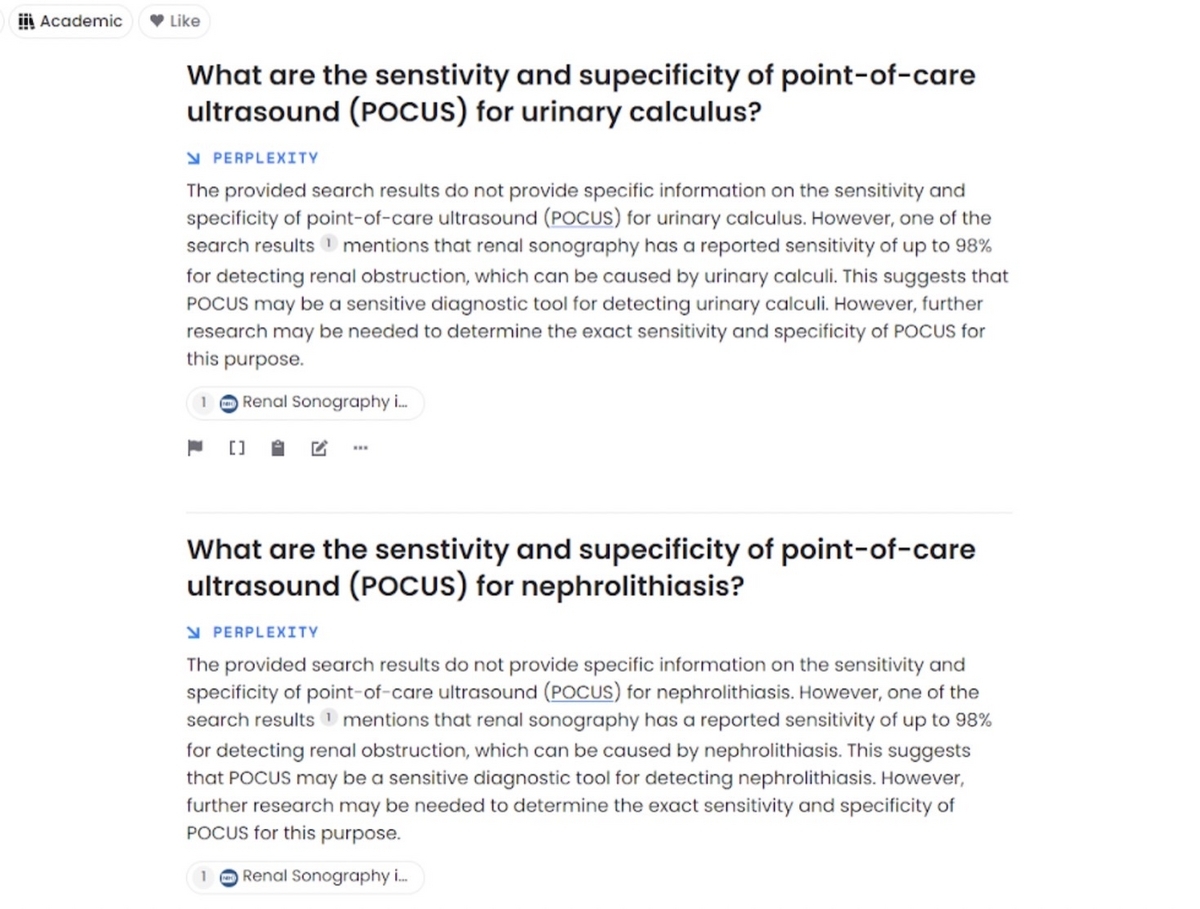

2-2.「Academic」×Perplexity AI

引き続き、尿路結石症に対する超音波検査の診断特性(感度・特異度)について「Academic」で尋ねてみました。

まさか、特異的な情報は無いと言っています。そして、出典もRCTはおろか、観察研究でもありません。もちろん、このような結論となった研究があったのは記憶してるので、出典が他にあったんじゃないか(孫引きしていけばたどり着く)というようにも考えられますが、今回の回答は実用的ではありません。

出典もCommentaryのようなものです。これは、以前のブログの記事で用いたSystematic Reviewでも腎結石(nephrolithiasis)であったように、検索の条件不足なんでしょうか。尿路結石を腎結石に変えて、質問してみましたが、回答は先ほどと同じでした。

さらに、POCUSではなく、超音波(ultrasonography)としてチェックしてみましたが、相変わらず同じ回答でした。対象となっている論文の問題でしょうか。分かりません。諦めることにします。

まさかの「All」設定の方が掴みどころのある回答でした。

3. 番外編: ChatPDFを使ってみる

最後の「Academic」設定にて、尿路結石症の超音波検査について調べた結果がまさかの結果でした。それを補完できるものを考えました。

論文のPDFが確保できれば、大丈夫というものを紹介します。論文のPDFを対話型AI(チャットAI)に与えると、AIがそのPDFに基づいて返答してくれる便利なアプリを試してみたいと思います。

日本語には対応していません。英語ならではの自然言語処理による対話型AIになります。そういう意味では、やはり英語が大切ということでしょうか。

3-1. 尿路結石症に対する超音波検査

それでは、先ほどのPerplexity AIでも誤った内容を生成していた文章のもとになった論文を用いてみようと思います(以前の尿路結石の記事でも紹介した論文です)。

ChatPDFでは、POCUSの感度、特異度についてどのように回答してくれるのか楽しみです。

主な結果について尋ねてみました。1つ目の感度、特異度の回答が間違っています。ChatPDFによる回答は、Radiology Ultrasoundにおける感度・特異度として、論文内でPOCUSとの対比用に他から引用されていた文章をもとに生成されたものです。

ChatPDFでは誤って、“1) POCUS is a highly accurate diagnostic tool for nephrolithiasis in the emergency department, with a pooled sensitivity of 0.91 (95% CI, 0.85-0.95) and specificity of 0.96 (95% CI, 0.93-0.98)”と書かれています。正しくは、先述の通り、“The pooled results for sensitivity and specificity were 70.2% (95% confidence interval [CI] = 67.1%-73.2%) and 75.4% (95% CI = 72.5%-78.2%), respectively”になります。

自然言語処理においては、誤った回答でも、文字列として整合性が取れていると判断されるのでしょう。

3-2. 他でも使ってみる

粗探しをすれば、たくさんダメな点は見つかるでしょう。論文を読む気がしないときのお供のような使い方もできます。次のNEJMの論文をもとに実験してみました。

メリットは、あくまで対話形式で聞けるぐらいでしょうか。わざわざPDFをChatPDFに移す手間を考えたら、NEJM上でアブストラクトを読めばいいような気もします。最近では、アブストラクトだけでなくRESEARCH SUMMARYのような視覚的なイメージを上手に使った見やすいものも増えています。

気になる方は、とりあえず使ってみて下さい。

4. まとめ

Perplexity AIは、一般的内容の全体像の把握、出典巡りのような視点や、自分なりのちょっとした仮説に合致するような論文探しのような視点で役立ちそうです。

そして対話型AI(チャットAI)全体としては、ぼんやりと間違ってる情報も入っているけど、ゼロよりはいいかもという程度の情報と捉えればいいかもしれません。使用する言語によっても大きく異なりそうです。英語であれば、ChatGPTよりもPerplexity AIの方が出典があることから情報検索としてはまだ使える機会が多くなりそうです。

日本こそ、母国語で医学を学ぶ環境に恵まれているので、逆説的に英語への壁はあるかもしれません。アジア等の非英語圏の医学生・医師と会うと、彼らは英語で医学を学んできているので、医学を学び始めた時の大変さこそありますが、その後の伸びしろとしての羨ましさも感じます。英語であれば、対話型AIでもChatGPTやPerplexity AIだけでなく、他にもGlass AIをはじめ、多数あります。

やはり、医学情報へのアクセス・アップデートという意味での英語の必要性は感じます。対話型AIは使わなくても、Evedence Alertsのようなメールサービス(新たな論文の一覧を各自の設定したレベル・頻度・内容に応じて送信)や、主要な医学誌のメールサービスの利用のような英語での便利サービスもあります。

今回の対話型AIの一連の記事の環境では、ChatGPTでも無料版(ChatGPT 3.5)になります。有料版(ChatGPT 4)であればマシな可能性はあります。またプロンプトの制限なのかわかりませんが、医療専用にはなり切れていないように感じます。医療の情報収集用として課金するなら、UpToDateやDynaMedのような医療情報の2次情報媒体に課金したほうがいいと考えています。もちろん、先日の記事のような事務的な補助であれば、ChatGPTは日本語も使えるので日本の現場では使える場面もあるでしょう。

対話型AIに期待しすぎずに使えるところで使ってみて効率化する、補うというような視点でとりあえず、少しでも触れてみてはいかがでしょうか。使ってみてダメそうなら、ダメでも良いと思いますし、たまに使えそうな時があるというような判断でも良いと思います(笑)。

まずは日本語で使えそうなChatGPTから使ってみたいという人は、よろしければこちらもご覧ください。

【関連記事】

対話型AIとの比較用の元となったブログ記事はこちらになります。